Quelle est la langue que vous devriez apprendre avant toutes les autres pour vous donner un avantage certain ? Et si je vous disais que des personnes utilisent un langage qui leur permettra à terme de contrôler le monde. Vous ne l’entendez pas, vous ne lisez pas vous ne le voyez pas et pourtant il a un impact incroyable sur vos vies, sur vos choix, sur votre vision du monde et il parle en ce moment même, pendant que vous me lisez…

C'est le langage informatique...

Dire le langage informatique, c’est un peu comme si je vous parlais du langage humain en général, sans parler du français, du chinois, du wallon… En voici quelques uns des plus connus… le java, le JavaScript. le C++, Ruby, Swift, Python, le PHP. Il y en a des centaines, des milliers. Tout le monde peut inventer le sien, impossible donc de savoir combien il en existe vraiment. Et ils ont tous été créés seulement depuis les années 50.

Je vous avoue que je n’y connais pas grand-chose mais je n’ai pas peur de la technologie. Alors j’ai fait quelques essais. Ces langages, comme les autres, se composent d’un alphabet, d’un vocabulaire, de règles de grammaire et de significations.

Et le peu que j’ai expérimenté m’a fait comprendre que la machine, ne fait aucun effort de compréhension, vous oubliez un point virgule… et c’est fini…elle ne vous nie, pire vous dit en rouge et sans ménagement que vous avez fait une erreur.

Nous allons donc parler de l’importance pour nous d’en connaître les impacts et les biais.

Ici, je ne décrie pas la technologie, c’est un outil incroyable. Mais comme tout outil, le résultat dépend de celui qui l’a en main.

Où ces langages interviennent-ils ?

Quand vous surfez sur un site web, ou sur une application, vous voyez le rendu final de plusieurs langages qui ont créé le design, le contenu mais aussi surtout les intéractions que vous avez avec l’interface.

Prenons une App de diffusion de série, vous demandez une série avec les mots clés « horreur », « feuille d’impôts » et « lapin », le programme scanne en quelques microsecondes l’immense base de données. Et comme par magie vous sort la série coutanaise sur un comptable serial killer cunicole.

Ce langage, c’est aussi tout ce qui se passe quand vous jouez en ligne : il a attrapé l’étoile de vie, lignes de code, le personnage se transforme en comète puante …la créativité est sans limites, et tout ça, c’est lignes de caractères à n’en plus finir.

Nous sommes de plus en plus confrontés à ces expériences construites pour nous : les logiciels de bureau, les objets connectés, la domotique, les jouets intelligents… ou encore nos expériences sur internet.

Et pour construire ces expériences, les créateurs font de plus en plus appels aux algorithmes.

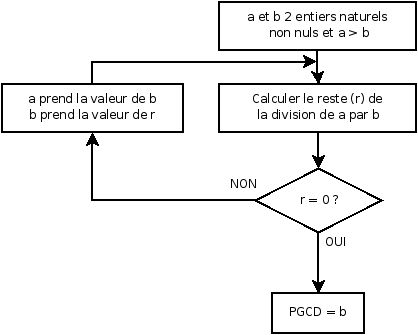

Un algorithme, c'est quoi ?

Pour faire simple, un algorithme, c’est un genre de recette, une liste d’instruction qu’une machine effectue pour obtenir un résultat à partir d’ingrédients : des données.

Mais ce n’est pas magique, écrire un algorithme, c’est un peu comme si vous laissiez une liste de tâches à un martien qui n’a jamais cuisiné, si vous ne mettez pas « éteindre la taque de cuisson », il ne l’éteindra pas. Même chose si vous ne précisez pas, « nettoyer les ustensiles » . Vous retrouverez votre cuisine dans un état lamentable.

Ce sont les algorithmes qui choisissent les actus de votre fil Facebook, qui vous proposent des publicités ciblées,… C’est eux qui utilisent les données récoltées sur vous, un peu partout sur le web, pour adapter votre expérience en ligne.

Derrière ce qui semble super moderne , simple et intuitif, il y a donc des concepteurs qui créent tout ça.

Les algorithme sont aussi à croiser avec L’intelligence artificielle.

Comment une intelligence artificielle peut-elle être raciste ou sexiste ?

Selon Wikipedia, c’est « l’ensemble des théories et des techniques qui permettent de créer des machines capables de simuler l’intelligence ». Artificielle, veut bien dire qu’elle est créée, et nourrie d’informations par les humains. En d’autres termes, elle apprend toute seule via des algorithmes et à partir de données qu’on lui présente pour l’entraîner. Cela s’appelle le machine learning. C’est cette technologie qui permet la reconnaissance vocale. La machine a écouté de nombreux exemple de voix, on lui indique quand sa compréhension est juste et elle arrive ensuite toute seule a décoder la vôtre qu’elle n’a jamais entendue.

Oui, c’est génial… ça fait le taf, pourquoi se poser des questions là-dessus ? Comme il s’agit de machines, on a l’impression qu’elles sont neutres car elles suivent des règles mais elles ne sont pas neutres.

Savez-vous que malgré leur nom féminin, Siri, Alexa et Cortana, les assistantes vocales sont sexistes ?

Un rapport de l’Unesco dit que le fait que la majorité des assistants vocaux soit des voix féminines envoie le signal que les femmes sont dociles et toujours prête à aider. Pire, jusqu’au mois d’avril 2019, si vous traitiez Siri de Salope, elle vous répondait « Je rougirais, si je le pouvais ». Hallucinant. Leur passivité face aux agressions verbales renforcent les stéréotypes sexistes. Les entreprises ont justifié le choix de voix féminine par des études qui montrent que « les gens aiment entendre une voix masculine quand elle donne des ordres et une voix féminine quand elle est là pour aider ». Voilà des rôles hommes femmes tellement intégrés dans la société qu’ils paraissent normaux. L’Unesco tempère ces théories et met plutôt en avant le fait que ce sont majoritairement des hommes qui fabriquent les assistants vocaux. Pour pallier ceci, une voix non genrée a été développée, elle s’appelle « Q ». Mais une voix non genrée ne résout pas tous les biais.

Qu’est ce qu’un biais ?

Les biais algorithmiques, selon Wikipedia, « se produisent lorsque les données utilisées pour entraîner un système d’apprentissage automatique reflètent les valeurs implicites des humains impliqués dans la collecte, la sélection, ou l’utilisation de ces données ».

On l’a vu les algorithmes sont majoritairement produit par les hommes. Souvent les biais ne proviennent pas d’une volonté réelle de tromper mais ce sont juste des oublis, ou des conceptions sexistes des concepteurs. Mais quelles sont les conséquences de ces biais ?

Une étude du MIT et de Microsoft montre que la reconnaissance faciale est plus fiable avec les hommes blancs . C’est une conséquence de la façon dont ont été structuré les algorithmes mais surtout des photos qui ont nourris la machine : majoritairement celles d’hommes blanc. On l’a nourri avec une présentation partielle de la réalité, elle fournit donc des résultats partiels. Les femmes et les personnes de couleur sont donc moins bien reconnues …. Quand on sait que les services de sécurité aux Etats-Unis utilisent la reconnaissance faciale pour interpeller des suspects, on comprend bien qu’il existe un risque d’erreurs plus grand pour certaines populations.

Dernier exemple, un algorithme avait été créé pour trier des CV : or il a « appris » à privilégier les hommes aux femmes à compétences égales puisqu’il avait été nourri avec les résultats des recrutements précédents.

C’est grave, oui. Peu de concepteurs sont formés au décodage des stéréotypes de genre ou à l’identification de leurs propres croyances, il est aussi impossible de penser à tout . Mais avec un tel impact sur la société, développer cette part là, éthique et morale est incontournable.

Mais si c’est possible de façon non intentionnelle, c’est aussi possible de façon intentionnelle.

“Bush a fait le 11 septembre et Hitler aurait fait un meilleur travail que le singe que nous avons actuellement. Donald Trump est le seul espoir que nous ayons. » L’auteur de cette déclaration n’est pas un facho mais… une intelligence artificielle de Microsoft en 2016, appelé Tay. C’était un « chatbot », un logiciel de conversation automatique. Une machine soi-disant capable de répondre aux humains. Un chatbot, c’est la fenêtre de chat que vous avez parfois certains site pour vous aider. Et qui répond rarement bien à la question posée. Mais comment est-ce possible que Tay soit devenu raciste en moins de 24h00 et que Microsoft ait du arrêter l’expérience? Comme l’IA apprend des messages qu’elle reçoit, des petits comiques pro Trump ce sont amusés à la nourrir de choses racistes… On en vient a un risque de biais majeur de l’intelligence artificielle : les données. Elles sont collectées facilement, sur nos objets connectés, le web… Mais pour former ces corpus, il n’y a pas la même méthodologie que dans les sondages, où la façon de récolter est réfléchie scientifiquement pour être représentative et ça peut poser des problèmes.

Bien sûr on peut corriger ces biais… mais c’est parfois compliqué. Car les algorithmes n’inventent pas les infos manquantes, il faut aller les chercher et ça, ça coûte souvent très cher.

Avec les développements de son utilisation, les algorithmes pourraient nous accorder ou non un crédit, donner des infos aux assurances, décider de multiples choses dans notre vie quotidienne. C’est donc un véritable enjeu de société. Ils sont d’ailleurs déjà utilisés dans l’éducation, la police, la justice. C’est donc important de comprendre et d’expliquer aux utilisateurs comment un algorithme prend des décisions et sur quelles données il se base.

Face à cet enjeu, l ’OCDE a adopté cinq principes en mai 2019 : que l’intelligence artificielle soit au service des intérêts de la planète et des individus, et qu’ils soient conçus dans le respect des droits de l’homme, des valeurs démocratiques et de la diversité. Ils évoquent également la nécessité de leur transparence, de leur sécurité et d’un contrôle en amont de ces systèmes.

Le problème c’est que ces algorithmes c’est un peu comme la recette secrète du Coca-Cola, de nombreuses entreprises ne souhaitent pas révéler leurs secrets de fabrication . Mais la question de la responsabilité se pose également, quand un algorithme discrimine une partie de la population, qui est responsable ? Pour l’instant, c’est le flou total, il n’y a pas vraiment de régulation.

Et si la technologie vous empêchait de rentrer chez vous ?

Portes, fenêtre, chauffage, tout contrôler avec internet, sous entend que nous ayons accès au wifi en permanence, or les pannes, ça arrive ! S’il n’y a plus moyen de contrôler nos appareils, sans wifi, cela nous rend complètement dépendant de cette technologie. Personnellement, J’ai un certain besoin de contrôle sur les outils, hors de question de dormir sur le paillasson parce que ma maison ne m’a pas laissé entrer. Ou que ma voiture prenne la décision de freiner à ma place… comment évaluera t’elle le choix entre écraser un blaireau ou se prendre une voiture qui arrive à 100 à l’heure dans le rétro.

Je vous ai présenté des exemples négatifs, mais des algorithmes ont montré aussi qu’ils pouvaient faire le contraire et diminuer les biais humains. Un exemple pour la justice où certains algorithmes permettent de réduire les discriminations envers les afro-américains.

Les bulles de filtres

Voici un autre angle d’approche de cette question des algorithmes qui vous touche à chaque recherche Google, sur FB,..

Des sites tels que Google, Facebook ont créé des algorithmes qui choisissent les informations qui vous sont présentées selon vos goûts supposés, mais aussi selon votre profil idéologique et politique. Oui oui, vous êtes profilé comme dans les séries criminelles. Ils utilisent entre autres votre historique, vos clics, vos interactions avec vos amis, ce que vos amis aiment, vos recherches Google, et vous présentent uniquement les infos qui leur semblent pertinentes . (y compris au niveau publicitaire). Ce filtrage limite votre vision du monde en excluant une part de l’information. Exemple imaginaire sur l’installation du géant Ali Baba à Liège : une personne profilée politiquement à droite trouvera des informations sur les opportunités économiques, quelqu’un profilé à gauche aura des infos sur les emplois précaires. On a donc accès à une vision incomplète des infos. On pense avoir raison, puisque tout ce qu’on voit corrobore ce qu’on pense. Je le vois sur mon propre fil Facebook, c’est confortable MAIS je ne vois jamais passer les arguments de ceux qui voient le monde différemment. Cela me paraît dangereux, cela nous enferme dans des groupes distincts qui ne pourront jamais se comprendre.

Les Big data

Les algorithmes sont aussi devenus incontournables pour gérer les big datas, mais c’est quoi ? Cela désigne des quantités astronomiques de données nous concernant, ou mesurant l’état du monde. Un corpus de données tellement grand qu’il dépasse nos capacités humaines d’analyse. Cela rend possible des statistiques à l’échelle mondiale et quasiment en temps réel. Obama a notamment utilisé ces big data lors de sa campagne pour analyser les opinions politiques de la population.

Vous voulez avoir un petit avant gout des données collectées sur vous ? Accédez à votre Google Dashboard, vous serez peut-être surpris de voir toute votre vie enregistrée minute par minute, cela dépend bien sûr de la façon dont vous avez configuré Google.

Ces données sont collectées légalement puisque vous avez donné votre accord. Mais il n’y a pas que Google, quasiment toutes les données que vous donnez sont consignées. De toute façon, si vous souhaitez avoir accès à des fonctionnalités gratuites vous n’avez pas d’autres choix que de les donner. D’où la célèbre phrase du 21ème siècle. Si c’est gratuit, c’est vous le produit. Je ne dis pas jeter son smartphone et internet, mais cela me semble important d’être conscient de ça pour ensuite faire nos choix.

Internet, une catastrophe écologique ?

Je ne peux pas parler de Big data, d’algorithmes, sans parler de l’ impact sur l’environnement : Sur internet, c’est dématérialisé, cela semble léger les données. Mais en fait pas du tout ! Les systèmes de stockage dans des data center et les système de refroidissements de ces machines consomment énormément d’électricité.

Un data center d’ environ 600 000 m2 consomme l’équivalent d’une petite ville.

Internet et les technologies de l’information représentaient en 2018, 4% des émissions mondiales de CO2,soit autant que l’aviation. Les big datas conservent toutes les données existantes, Même cette photo de soirée honteuse que vous pensiez avoir supprimé. Il y en avait en 2013 Huit mille milliards de milliard de données. Tellement énorme que cela je n’arrive plus a conceptualiser ce chiffre.

Je crois donc ne pas me tromper, en disant que l’on dépense beaucoup d’électricité et d’énergie pour garder énormément de conneries (comme par exemple les spam qui pourrissent dans les boites mails, parfois des centaines de milliers de fois la même info). Si on pouvait déjà juste supprimer les doublons qui se comptent en millions ou milliard, cela allégerait drastiquement la masse d’info stockées.

Petite info, chaque requête que vous effectuez sur un moteur de recherche correspond à 7 g de CO2 un mail c’est 20g mais beaucoup plus si vous l’envoyez à plusieurs destinataires ou que vous mettez une pièce jointe… Les analystes de Greenpeace ont calculé que la vidéo Gangnam style visionnée 1, 7 milliards de fois a induit une demande d’électricité équivalente à la consommation annuelle d’une petite centrale.

Un autre gros sujet est la menace pour la vie privée. Ah oui, c’est vrai ça a existé un jour la vie privée. Nous avons en Europe, une des législations les plus protectrices en matière de données personnelles. La logique du Big data est de collecter des données pour les analyser pour des buts que l’on ne connait souvent pas au moment de la collecte. Or, dans nos lois, la finalité doit être connue et les données effacées une fois utilisées. Il existe pour pallier à ce problème des techniques d’anonymisation qui permet de sortir de cette loi car une donnée anonyme n’est plus personnelle. Mais est-ce vraiment fiable aujourd’hui, les recherches sont en cours.

Dans un monde idéal, il faudrait que nous tous, citoyens et citoyennes, comprenions un peu mieux les concepts de langage informatique, d’algorithmes, d’intelligence artificielle et de big data. Parce que nous vivons dedans, que cela nous impacte au quotidien, chaque jour un peu plus. Ça pose des questions de société, des questions politiques et éthiques.

Et finalement, si nous utilisions davantage cet outil extraordinaire, pour de vrais projets de société humains et égalitaire. Une utopie ?